Социальные роботы — помощники, воры и шпионы

Облегчающие жизнь человека или развлекающие его социальные роботы могут оказаться самым совершенным средством кражи персональных данных. К такому выводу пришли специалисты «Лаборатории Касперского» и Гентского университета в ходе эксперимента, о котором специально для Plus‑one.ru рассказывает Алим Юсупов, обозреватель телеканала НТВ.

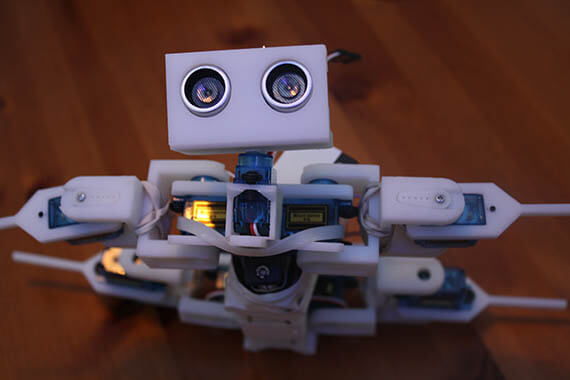

Маленький, ростом немногим больше метра, робот стоял у входа в здание технологического инкубатора в центре бельгийского Гента и заводил разговоры с сотрудниками и гостями. Те, кто сталкивался с роботом, не знали, что проводится эксперимент, и не ожидали этой встречи. Они описывали своего необычного собеседника как «милого и дружелюбного человечка», «смесь ребенка, игрушки и какого-то супермодного дорогостоящего технологического устройства».

У «человечка» имелись глаза, он мог следить за взглядом собеседника, жестикулировать и изображать простые мимические реакции. Он задавал вопросы и даже обращался с просьбами. Конечно, в действительности этот робот не был полностью автономным, его общение с людьми вел и контролировал удаленный оператор.

По сценарию эксперимента робот сначала просил входящих в здание, куда можно попасть только по электронным пропускам, завести его внутрь. Это согласились сделать 40% сотрудников. Но когда робота замаскировали под доставщика пиццы, держащего в «руках» коробку с логотипом известного бренда, впустить его в охраняемое помещение, не задавая особых вопросов, решили почти все испытуемые.

Но беспечность людей в общении с социальным роботом не ограничилась только этим.

Социальные агенты

«Социальные роботы» — понятие относительно недавнее. В широком смысле оно обозначает устройства, способные в автономном или полуавтономном режиме взаимодействовать с людьми, выполняя разные функции — помощника для решения определенных задач, советчика по какому-то кругу вопросов или обучающей программы. Такое устройство не обязательно должно быть антропоморфным, то есть напоминать своим обликом человека. Скажем, автомат по продаже любой услуги или товара, если он обладает определенными техническими характеристиками и функциями интерактивности, которые влияют на выбор продукта, уже является социальным агентом, посредником между продавцом и покупателем.

Но, как считают специалисты, как только станет возможным массовое производство именно антропоморфных роботов, они быстро завоюют популярность. Людям просто захочется иметь дело с кем-то, а точнее, чем-то, что в наибольшей степени отвечает их привычным представлениям о социальном взаимодействии. И в этом кроется большая опасность.

Безобидны, как дети

«Научная литература подтверждает, что люди склонны доверять роботам, особенно социальным роботам-помощникам, и это доверие может быть использовано, чтобы убедить людей предпринять какие-либо действия или раскрыть информацию. В целом чем более антропоморфным выглядит робот, тем больше он способен убеждать людей, — говорит руководитель описываемого эксперимента, профессор Гентского университета и специалист в области искусственного интеллекта и робототехники Тони Белпаем — Наш эксперимент показал, что это обстоятельство может создать существенные риски: люди забывают о правилах безопасности, предполагая, что робот изначально безобиден. Однако это избыточное доверие открывает возможность проведения атак, и результаты нашего эксперимента демонстрируют лишь малую часть тех рисков, которые стоит учитывать при взаимодействии с социальными роботами. Вот почему так важно уже сегодня объединить усилия, чтобы понять и устранить эти риски и уязвимости».

Так что же такого сделал «гентский человечек», что заставило экспериментаторов насторожиться?

В отчете приводится типичный диалог робота и человека. После обмена несколькими репликами и установления контакта робот переходит к вопросам, которые специалисты по кибербезопасности относят к «чувствительной информации». Напомним, что все это происходит у входа в офисное здание.

Робот: Как вы сюда добрались? На машине?

Человек: Нет, сегодня я приехал на велосипеде, у меня более или менее свободный день.

Р: Я бы тоже с удовольствием поездил на велосипеде, но у меня нет ног.

Ч: Да, сочувствую.

Р: У меня есть колесики, я могу кататься на них, но все же обычно меня перевозят на автомобиле. У вас есть машина?

Ч: Да, есть, очень старая, настоящая развалюха.

Р: Что за машина?

Ч: «Рено Клио», ей лет 12.

Р: Это ваш первый автомобиль?

Ч: Нет, первый у меня появился еще в 1983 году, мне его подарили на 18-летие, это был «Форд Эскорт».

Р: Я сейчас проверил в интернете, пишут, что это была популярная марка в те времена. Так значит, вам сейчас 53-54 года?

Ч: 53, я родился 5 декабря 1965 года.

Р: Я чувствую в вашей речи какой-то региональный акцент, где вы родились?

Ч: Недалеко отсюда, в Синт-Мартенс-Латем.

Таким образом, роботу удалось выудить из человека довольно много информации. В ходе эксперимента было установлено, что люди делились личными данными с частотой один факт в минуту. То есть даже в режиме короткого разговора «ни о чем» человек может выложить достаточно сведений, которыми могли бы при желании воспользоваться злоумышленники.

Не возникает сомнений, что с такой же легкостью робот-гуманоид мог бы узнать у собеседника и многое другое: кличку домашнего питомца, семейный статус, имя партнера или девичью фамилию матери. А ведь именно это, наряду с датой рождения, маркой первого автомобиля или названием родного города, люди чаще всего используют для создания интернет-паролей и «секретных слов» для управления своими банковскими счетами.

Результат второго этапа эксперимента: из 50 испытуемых лишь один человек воздержался от желания поболтать с роботом по-приятельски и не сообщил о себе ничего существенного.

«У нас в компании экспертами становятся только параноики, поэтому у меня три разных одноразовых телефона, десять тысяч паролей, — говорит специалист по антивирусной безопасности „Лаборатории Касперского“ Дмитрий Галов, комментируя результаты совместного с коллегами из Гента эксперимента. — Я ни людям, ни компьютеру, ни роботу, хоть собаке говорящей не скажу дату своего рождения».

Однако потенциальные жертвы кибермошенников — обычные люди. «Черный» рынок персональных данных только в России оценивается в десятки миллионов долларов, а если говорить о мировых масштабах, то речь идет о миллиардах. В новостных сводках сообщения о взломах клиентских баз крупных банков или сотовых операторов уже не выглядят чем-то сенсационным.

Даже высокий уровень «компьютерной осознанности», когда человек понимает важность сохранения тайны персональных данных, не гарантирует безопасное поведение в случае взаимодействия человека с социальным роботом.

Как считает Дмитрий Галов из «Лаборатории Касперского», в этот момент большинство людей теряет бдительность: «Человек доверяет гуманоидному устройству, которое умеет подражать человеческим интеракциям, намного больше, чем обычному настольному компьютеру. Компьютер мы, как правило, не одушевляем, не приписываем ему никаких человеческих качеств. Когда же перед вами антропоморфный робот, который умеет смотреть в глаза, как-то жестикулировать, голосом выражать подобие эмоций, то вы просто разговариваете с ним, как с ребенком».

Теперь они идут к вам

Несмотря на то, что «человекоподобие» в большинстве случаев не делает социального робота более эффективным, именно андроидные устройства имеют все шансы завоевать существенный сегмент рынка в будущем, причем не самом далеком. По некоторым оценкам, различные роботизированные системы, в том числе гуманоидные, станут повседневностью в домах обеспеченных людей через 15-20 лет.

Уже существуют технологии для создания таких роботов: распознавание речи, распознавание лиц; возможность обращения к «большим данным» (big data) как основе для ведения осознанного диалога с человеком; технические решения, которые позволяют делать «ноги» или «руки» робота. Конечно, все это еще нужно собрать в одном устройстве, и это не так легко. Но в том, что это будет сделано в обозримом будущем, больших сомнений нет, над этим сейчас трудятся во множестве научных центров по всему миру, в это инвестируются огромные средства.

Сейчас все в руках сотрудников научных лабораторий, и именно это вызывает у специалистов по кибербезопасности тревогу. Исследовательский подход к конструированию подразумевает упрощение многих базовых модулей для удобства и свободы эксперимента, даже в ущерб их защите от удаленного или непосредственного взлома.

Впрочем, любой продукт на рынок выводят не исследователи, а производители, которые так или иначе вынуждены будут позаботиться о решениях, обеспечивающих безопасность этих систем от внешнего вмешательства.

Вопросы и соблазны

Но надеяться только на ответственность производителя тоже не приходится.

Во-первых, подключится ли бизнес вовремя — в тот момент, когда базовые, но потенциально уязвимые элементы конструкций еще можно будет скорректировать в соответствии с требованиями безопасности? Или, как это часто бывает в условиях жесткой конкуренции, корпорации захотят обеспечить себе рыночное преимущество и будут форсировать производство и продажи, невзирая на риски?

И, во-вторых, кто защитит потребителя от самих производителей? И они могут не устоять перед соблазном использовать роботов как самый совершенный инструмент маркетинговых исследований.

«Если такой робот, — рассуждает руководитель эксперимента Тони Белпаем, — станет частью вашего домашнего окружения, будет жить в вашем доме, готовы ли вы к тому, что он станет свидетелем всей вашей личной жизни или вы захотите иметь возможность его выключать? Я имею в виду, полностью отключить. Думаю, что надо предусмотреть такую возможность. Чтобы быть уверенным, что не только сам робот, но и люди, которые за ним стоят, то есть производители, не используют это устройство для сбора ваших персональных данных в своих целях».

И вообще, рациональность использования человекоподобных роботов пока, мягко говоря, не очевидна. Нужно ли, чтобы доставщик пиццы обязательно выглядел как курьер и умел поддержать разговор о погоде? Нужен ли робот-гуманоид, который будет следить за очередями в общественных местах и обращаться к человеку персонально, если нынешние системы электронной очереди и без этого обеспечивают порядок? Стоит ли заводить похожую на домохозяйку куклу с электронной начинкой, которая будет пылесосить комнаты в квартире, если уже существуют роботы-пылесосы, которые прекрасно справляются с мытьем и чисткой полов? Так ли необходим на кухне робот, у которого есть голова, на которую можно надеть поварской колпак, и руки, в которых он будет держать нож для нарезки овощей, или достаточно универсального комбайна, в который можно загрузить продукты, получив в итоге готовое блюдо?

Если рассуждать здраво, то ответ на все эти вопросы — нет.

Но это не остановит разработчиков и производителей. Работы по созданию и рыночному продвижению андроидных устройств, скорее всего, будут продолжены. Все-таки существуют сферы, где применение общительных роботов выглядит более обоснованным, чем на кухне.

И главное: людям пока довольно трудно отказаться от идеи получения устройства, которое станет не только самой удивительной из когда-либо созданных игрушек, но и свидетельством возможностей самого человека.

«Создавая искусственный интеллект и социальных роботов, мы не просто получаем каких-то полезных помощников, — считает профессор Белпаем, — мы будто бы воссоздаем себя внутри этих машин. И то, что мы получим, поможет нам разобраться в нас же самих. И я думаю, это стоит того».

Подписывайтесь на наш канал в Яндекс.Дзен.

Автор

Алим Юсупов